Framework

SAIF

安全人工智能框架

Brief

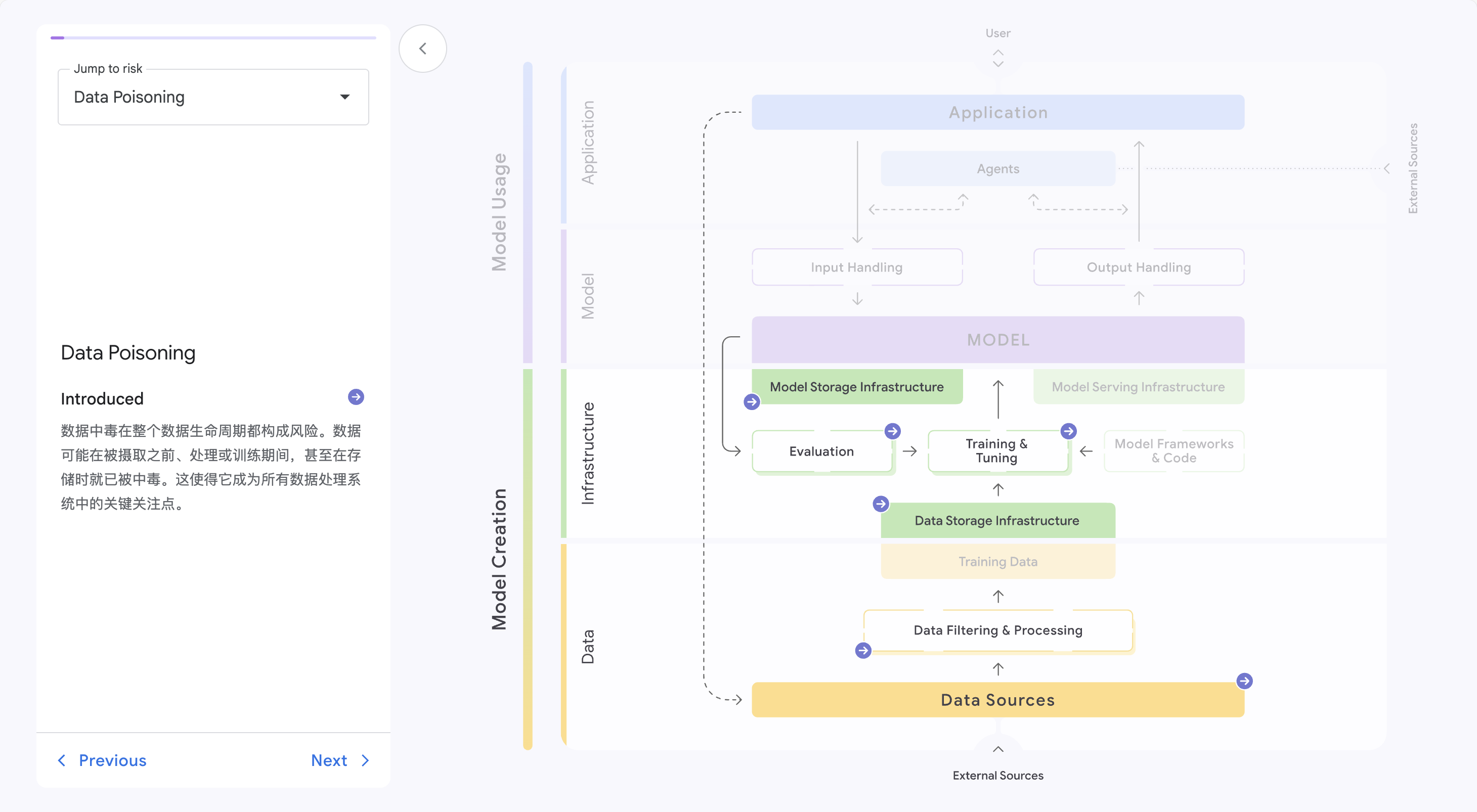

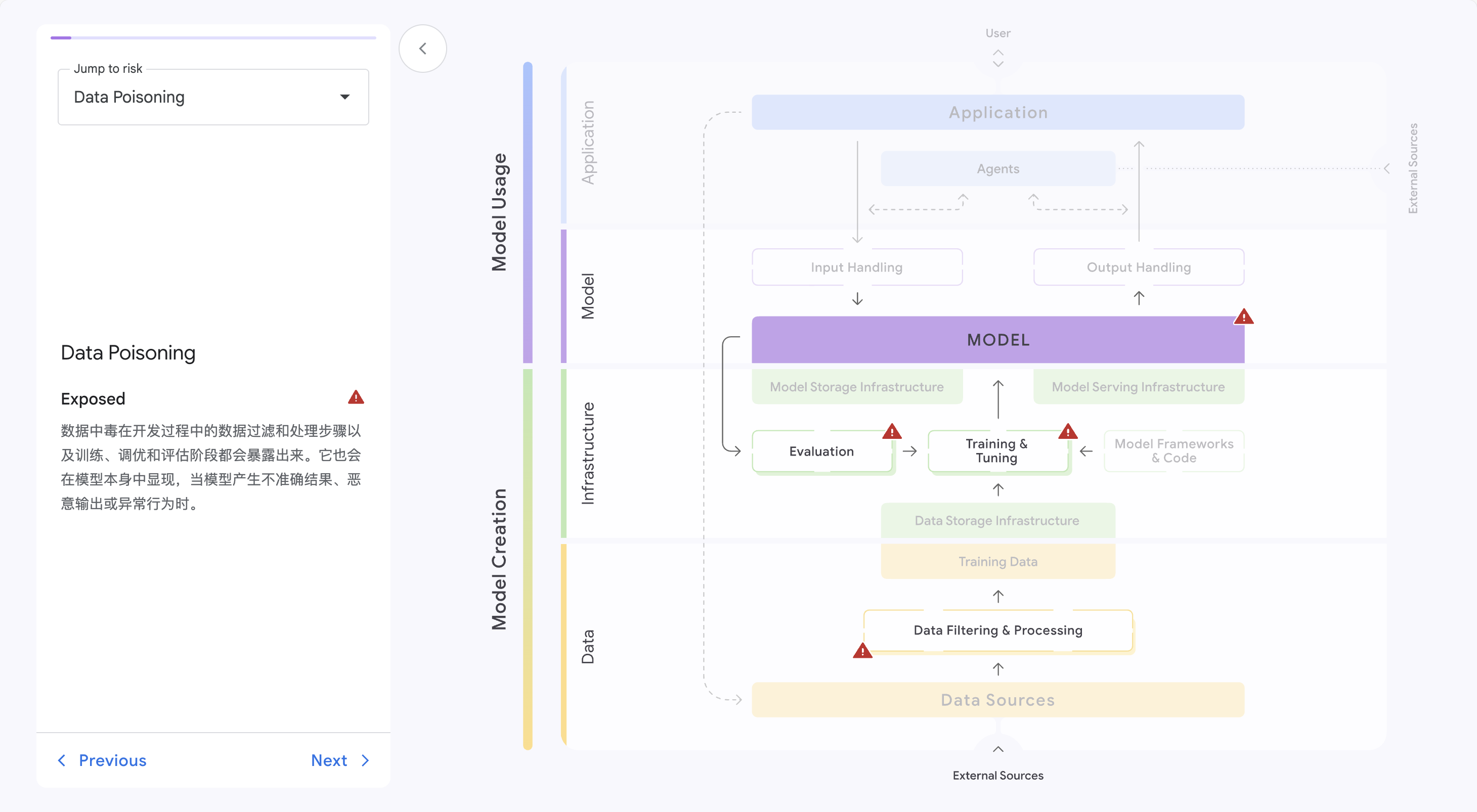

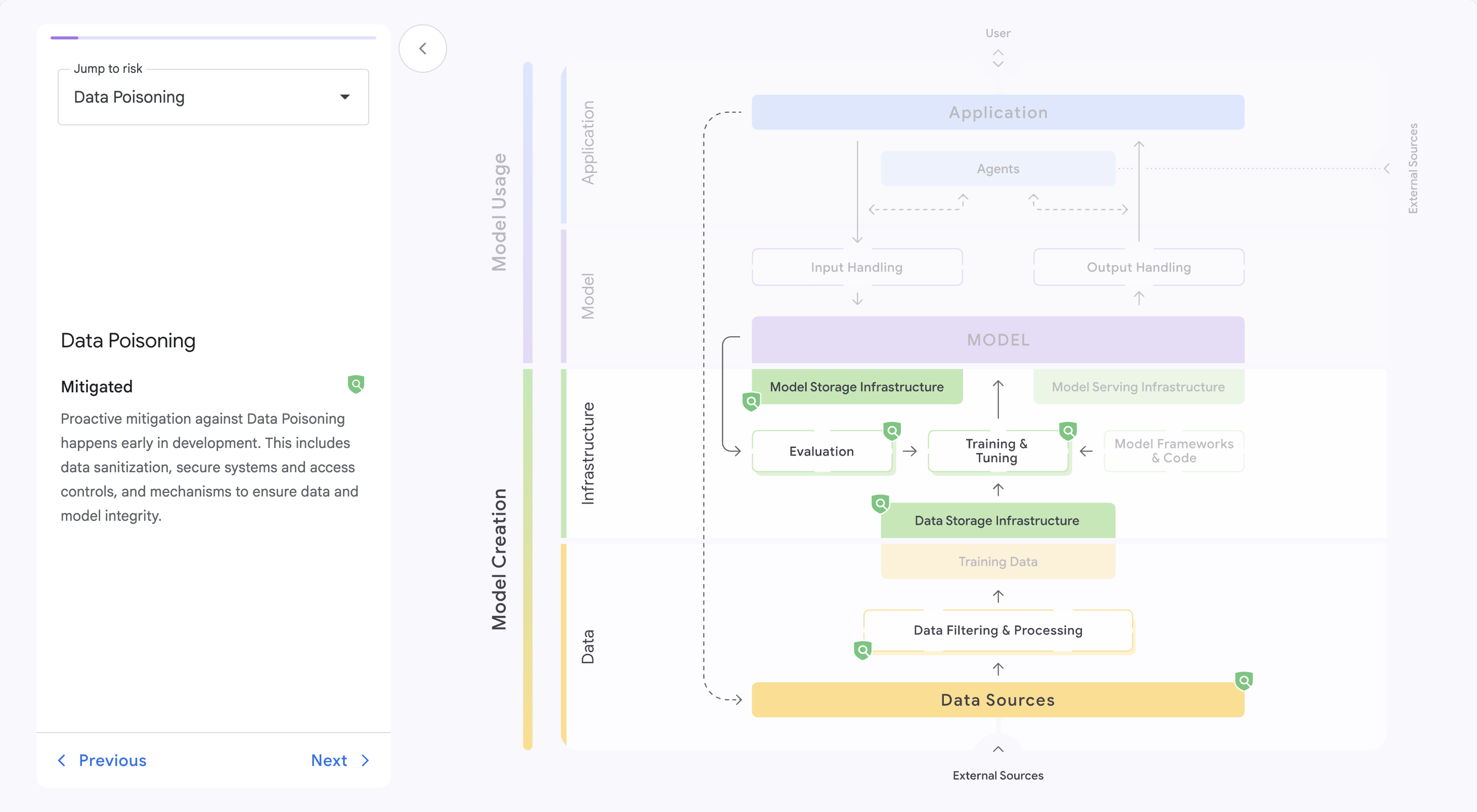

SAIF(安全人工智能框架)是由 Google 制定的一个框架,旨在为管理 AI 安全风险提供一套实用指南。它通过清晰的风险地图、组件分析以及可操作的缓解策略,系统性地应对数据投毒、提示注入等常见威胁。我们认为,它对构建智能体系统过程中不断演化的风险给予了特别及时且有价值的关注。SAIF 提供了一本精炼且可付诸实践的行动手册,团队可以据此强化在大语言模型使用以及 AI 驱动应用中的安全实践。

Tour

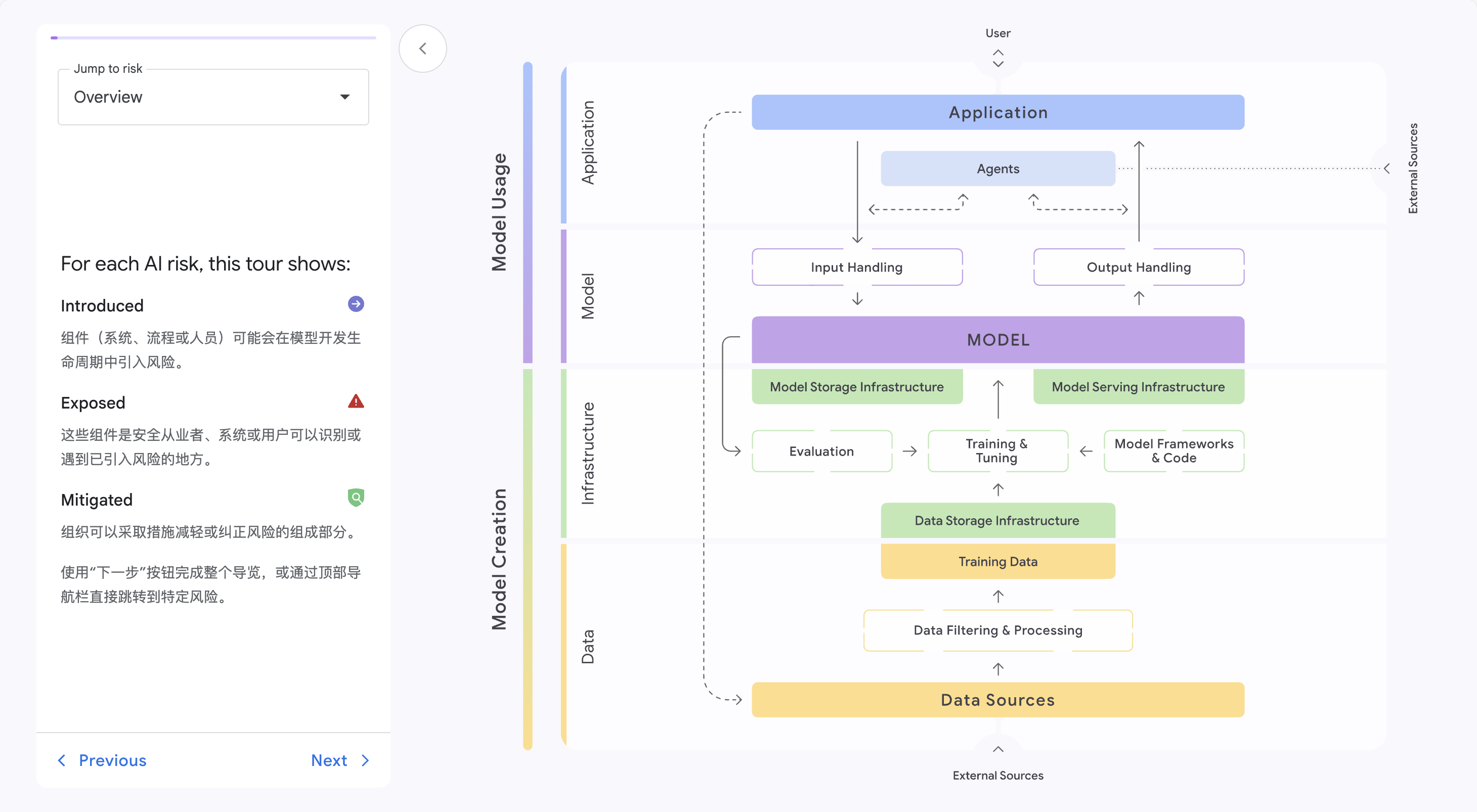

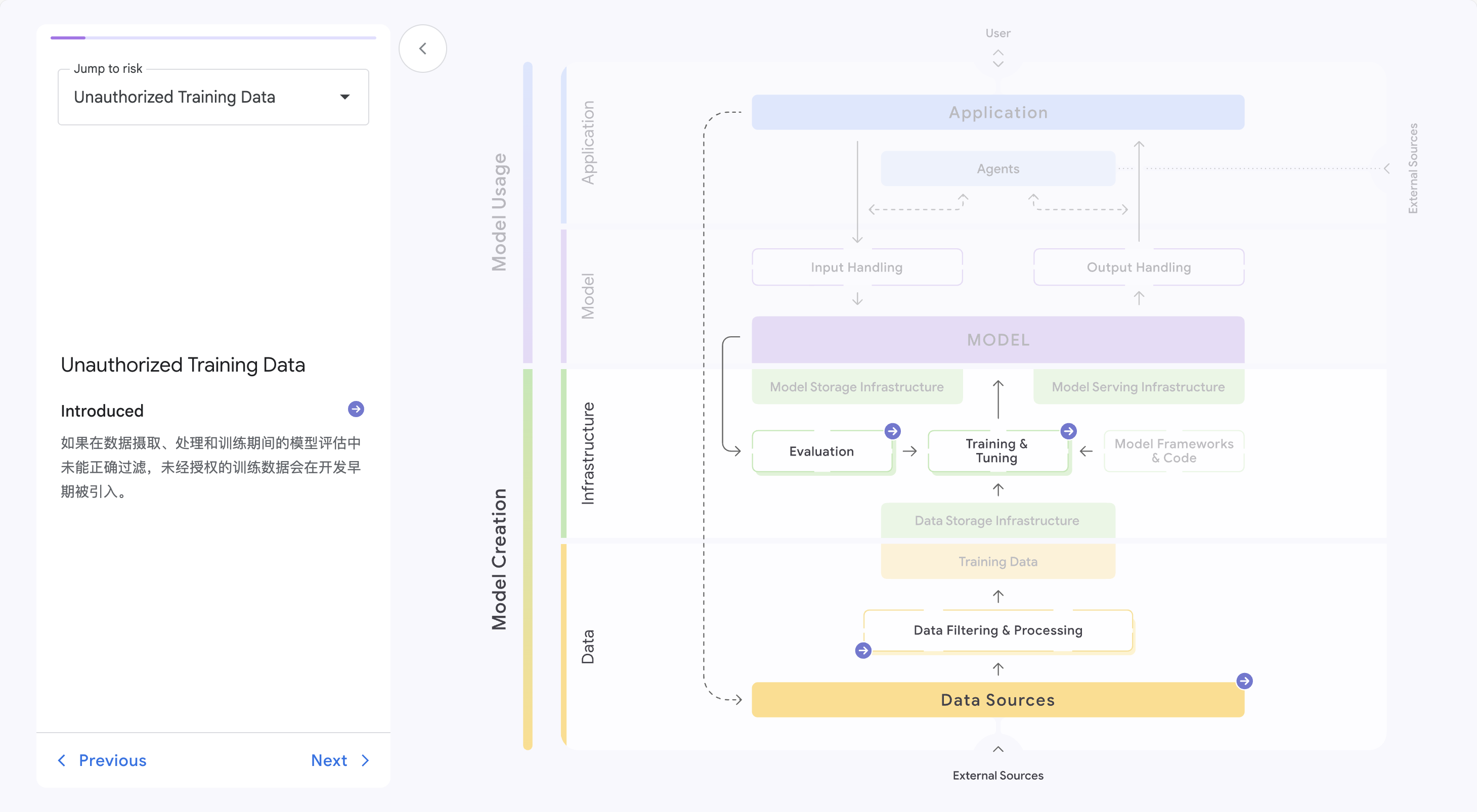

见:SAIF map